|  |  |  |

一场群聊,把我拉进了一个让我反复琢磨了好几天的问题。

起因是一本书——牛津大学出版社2013年出版的《预测的心智》,作者雅各布·霍维,丹麦人,在澳大利亚莫纳什大学教哲学。他在书里提出了一个核心主张:大脑的根本功能,是构建一个关于世界的内部模型,通过不断预测、不断修正感官输入,来最小化预测误差。

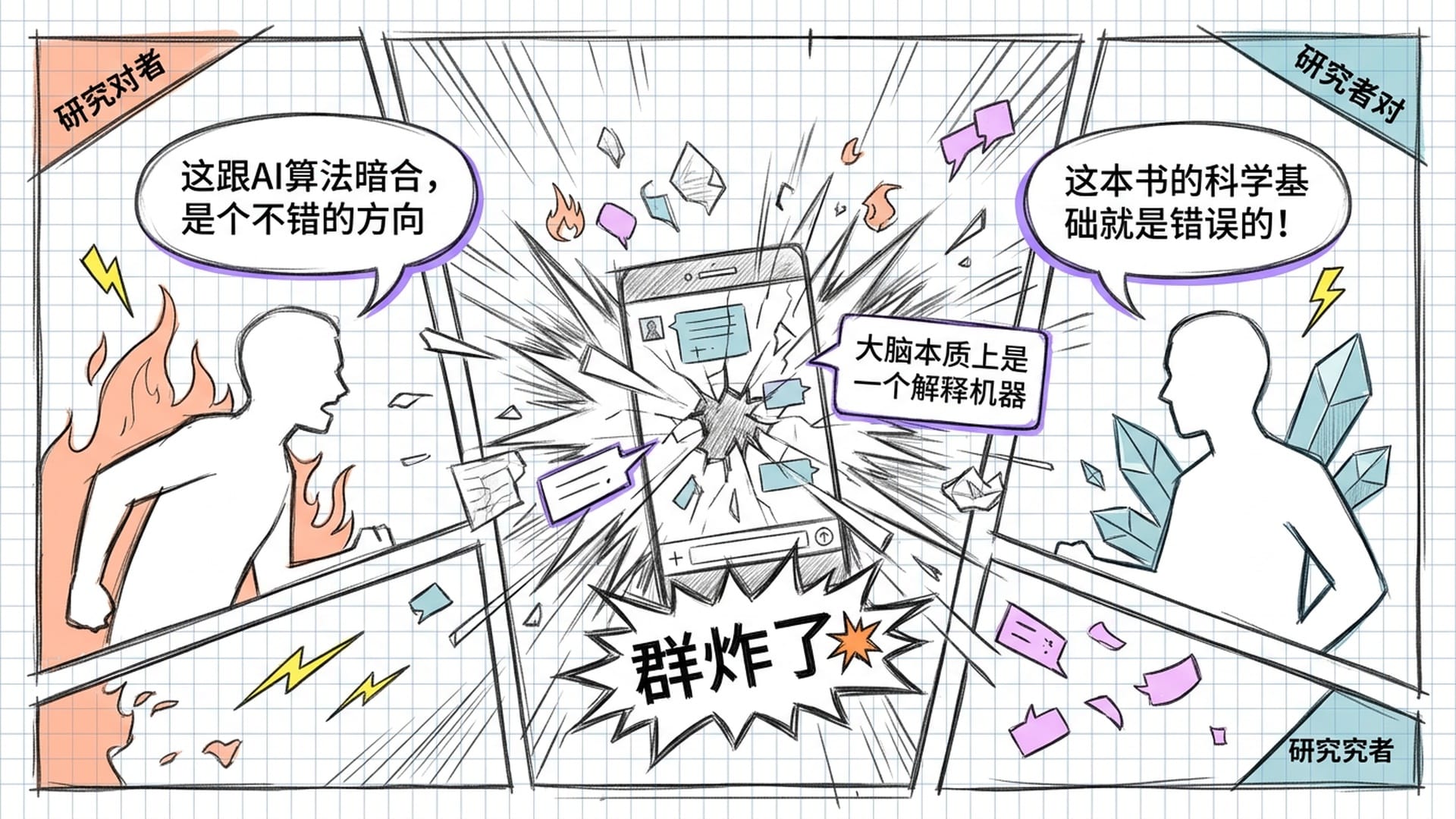

这句话,和今天训练人工智能大模型所用的那套数学逻辑——梯度下降、损失函数最小化——在底层结构上高度同构。群里一位同时做人工智能和量化交易的朋友看到这本书,说这跟AI算法暗合,是个值得深挖的方向。

然后,另一位做AI的朋友甩过来一句话——

"这本书的科学基础就是错误的。大脑本质上是一个解释机器,预测只是解释之后的反应,很多人搞混了这一点,以为预测是人脑的本能。"

群炸了。

先把霍维的理论讲清楚

在传统认知科学里,人们曾以为大脑是一个被动接收器——眼睛、耳朵、皮肤把信号送进来,大脑像一台解码机,把这些信号拼出一幅世界的画面。这个观念非常直觉,也非常错。

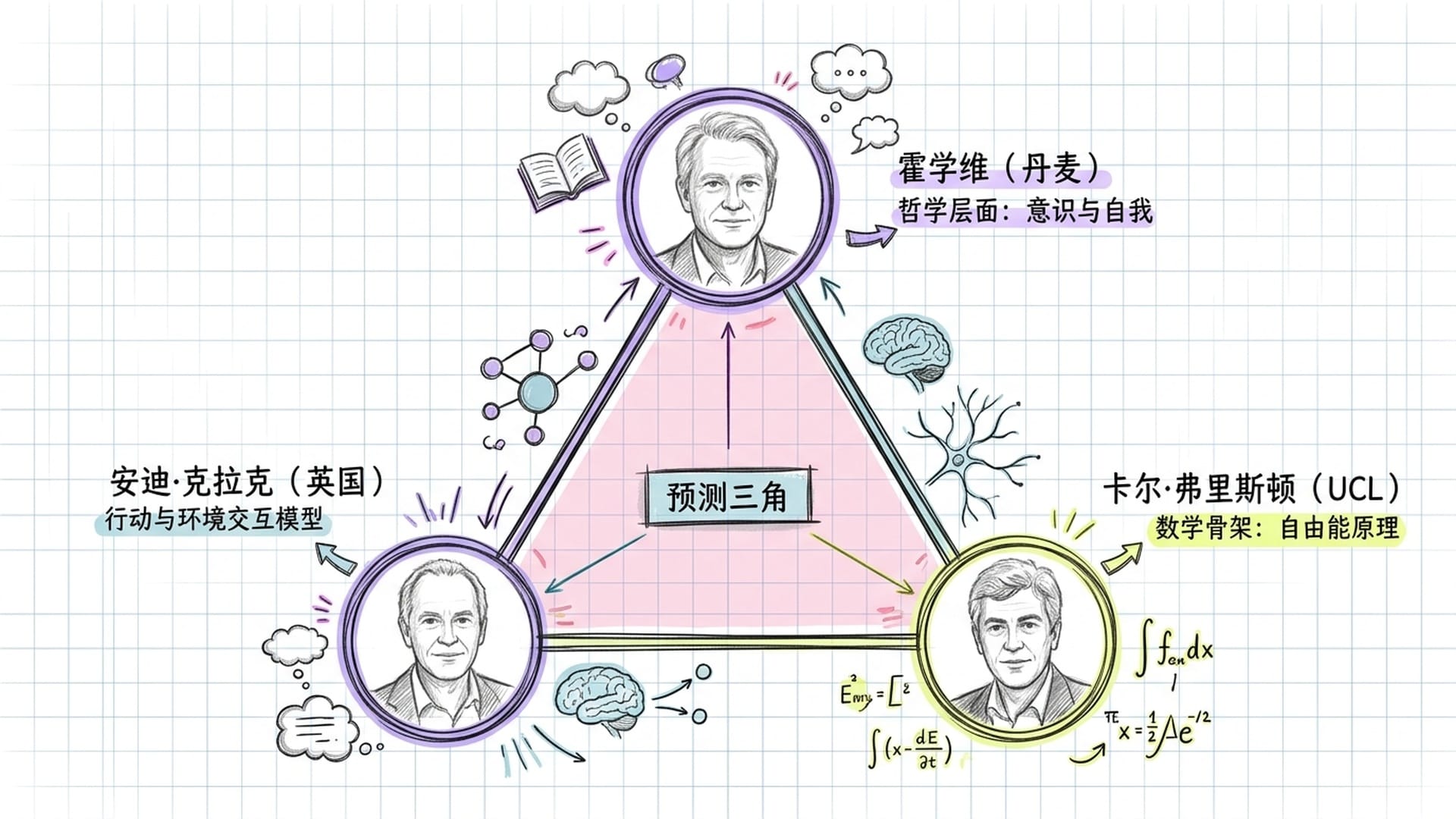

霍维和身边两位学者在近二十年里,把这个观念彻底颠覆了。这三人通常被称为**"预测三角"**:

- 英国哲学家安迪·克拉克,负责行动、身体与环境交互的模型

- 伦敦大学学院神经科学家卡尔·弗里斯顿,提供数学骨架,即

自由能原理 - 雅各布·霍维,把理论拉到哲学层面,讨论意识与自我在这个框架里究竟是什么

他们的核心主张是:大脑不是被动反映世界的镜子,而是一个层级化的预测系统。任何一个瞬间,大脑的高层都在向低层下推一套假设——关于接下来会发生什么。

你伸手去拿桌上的杯子,大脑早就预测了那个杯子在视网膜上应该投出什么形状、指尖会接触到什么温度、手腕会感受到多少重量。感官输入进来,大脑不是在看见杯子,而是在检验关于杯子的假设。假设对了,一切风平浪静;假设错了——比如杯子比想象的烫——这个预测误差就会上行,逼整个系统更新模型。

用霍维的话说:感知,不是接受,感知是推理。我们看到的世界,其实是我们最佳预测的结果。

这套理论落到生活里,画面感极强。你走进自己家,闭着眼都能摸到灯的开关,因为大脑早已预测了它的位置。走进别人家,同一个动作就会摸空——模型不对,预测失败。你打字时几乎不看键盘,因为大脑已预判好每一次敲击的落点。熟悉的路上开车能一边听歌一边换挡,陌生的山路却让你全身紧张,因为预测精准度天差地别。

然后,这套理论被一句话质疑了

群里那位朋友的反驳,乍一听有点绕,越琢磨越有力量。

他的核心论点是:预测是从哪里来的? 你要预测未来的一秒钟,一定是基于你对过去无数个一秒钟的某种解释。没有解释,哪来的预测?

他认为,预测只是表面现象,真正在底层工作的是解释——大脑给感官输入赋予意义的那个动作。你看到一张脸,你先得解释它是一张脸;解释之后,才能预测它下一秒是微笑还是皱眉。把预测当成大脑的本质,就像看乐队演奏,只盯着鼓手说音乐就是打鼓——你错过了底下那些决定节奏与旋律的整体结构。

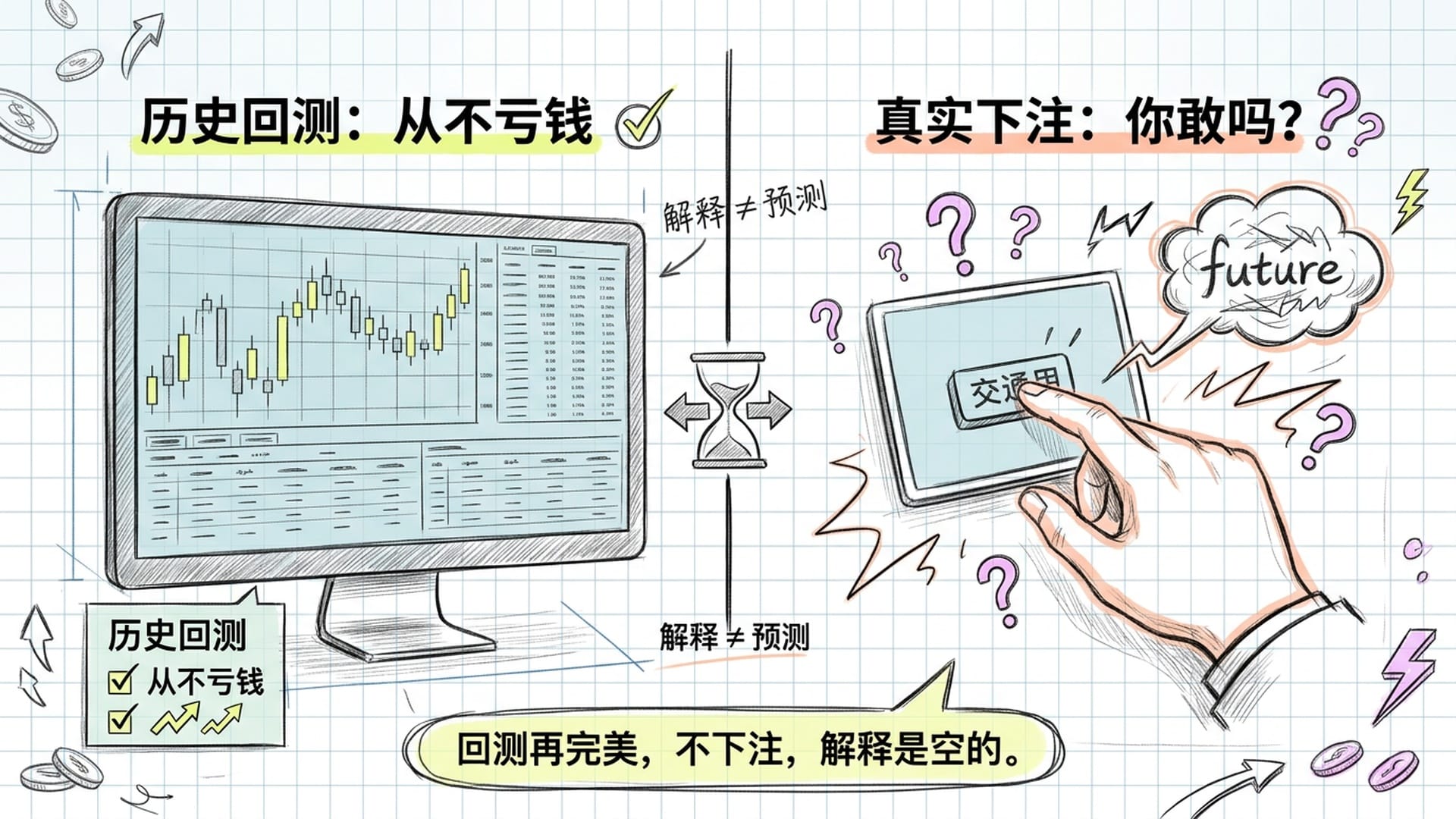

第一位朋友随即反击,举了一个极好的例子:如果大脑只是解释机器,做量化交易的人,把历史数据回测一遍就够了,何必真的下单? 一个在历史回测中从不亏钱的策略,你敢把所有的钱押进去吗?

没有真实下注,没有未来给你的那一记耳光,解释就是空的。你解释得再漂亮,不拿到真实世界里撞一撞,你根本不知道自己的解释对不对。

随后又有人补了一句更精准的刺——"以前生病从来没死过,所以这次生病也不会死。" 话糙理不糙。这是对只解释不预测这种思路最辛辣的讽刺。

其实,两个人各抓住了大象的一条腿

我看着这场讨论,觉得双方说的都对,但都只抓住了一半。

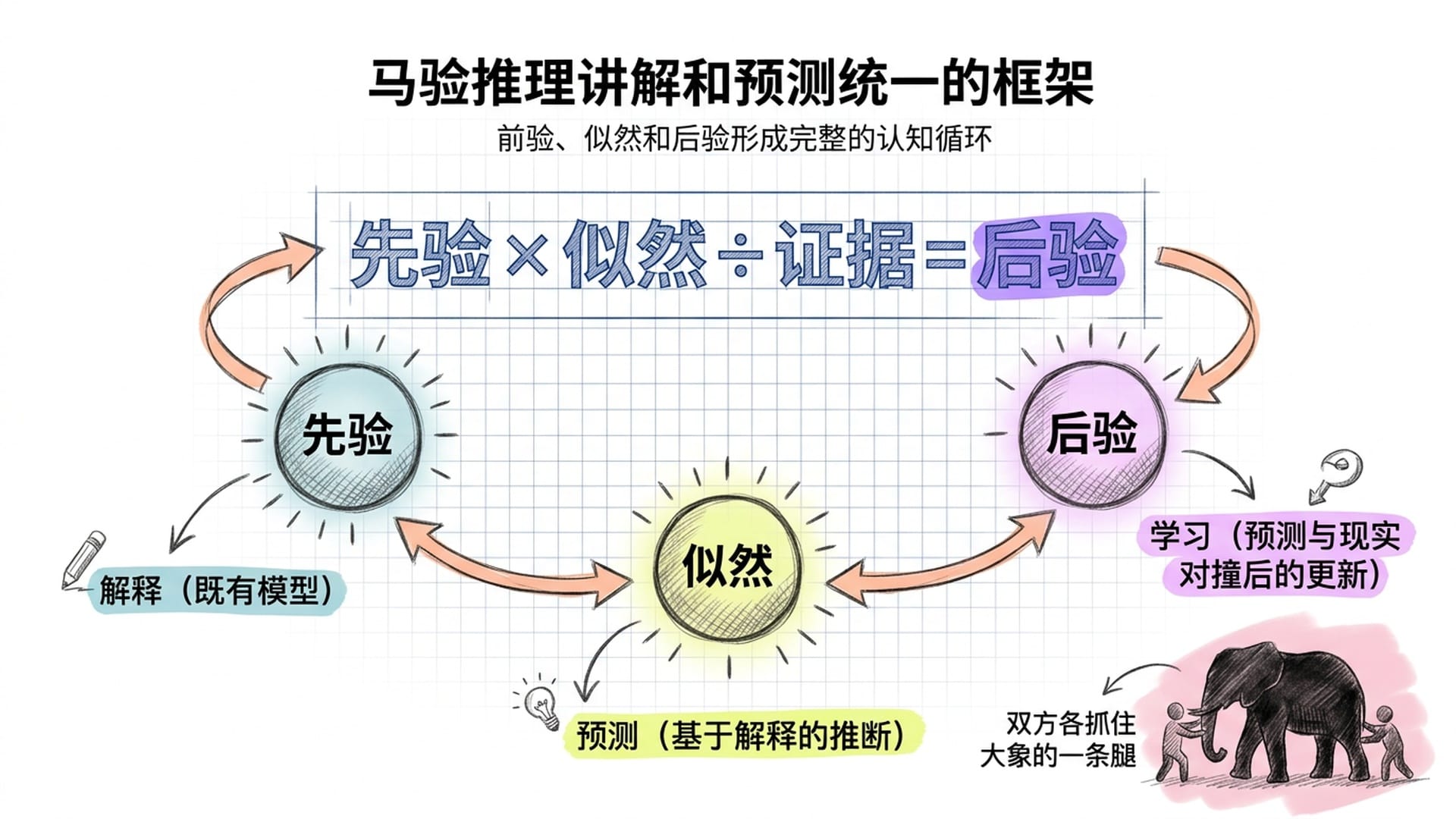

在贝叶斯推理里,有两个核心变量:先验,是你在看到任何数据之前对世界持有的模型;似然,是在这个模型之下,你对接下来数据的推断。两者相乘,再除以证据,得到后验——你看到数据后更新过的新模型。

先验,就是解释;似然,就是预测;后验,就是学习。三者缺一不可。

那位说"大脑是解释机器"的朋友,抓住的是先验那一端;说"大脑是预测机器"的朋友,抓住的是似然那一端。两人都对,但都只看到了半幅画。

大脑的完整工作是一个循环:解释(模型)→ 预测(推断)→ 观察(验证)→ 学习(更新)。霍维的预测心智理论,真正想强调的不是预测这个动作本身,而是误差最小化这个循环。

映射到量化交易,一切都清晰了:你对市场的解释是策略模型,下单是预测,市场给出盈亏是反馈,根据盈亏修正策略是学习。四个环节缺一不可。只解释不下单,模型永远停留在看起来很漂亮的状态;只下单不更新,你会把一个过时的模型撞到破产。

最深的那根钉子:世界一直在变

这场讨论还有一个更深的层次,被一句轻飘飘的话点出来——世界一直在变。

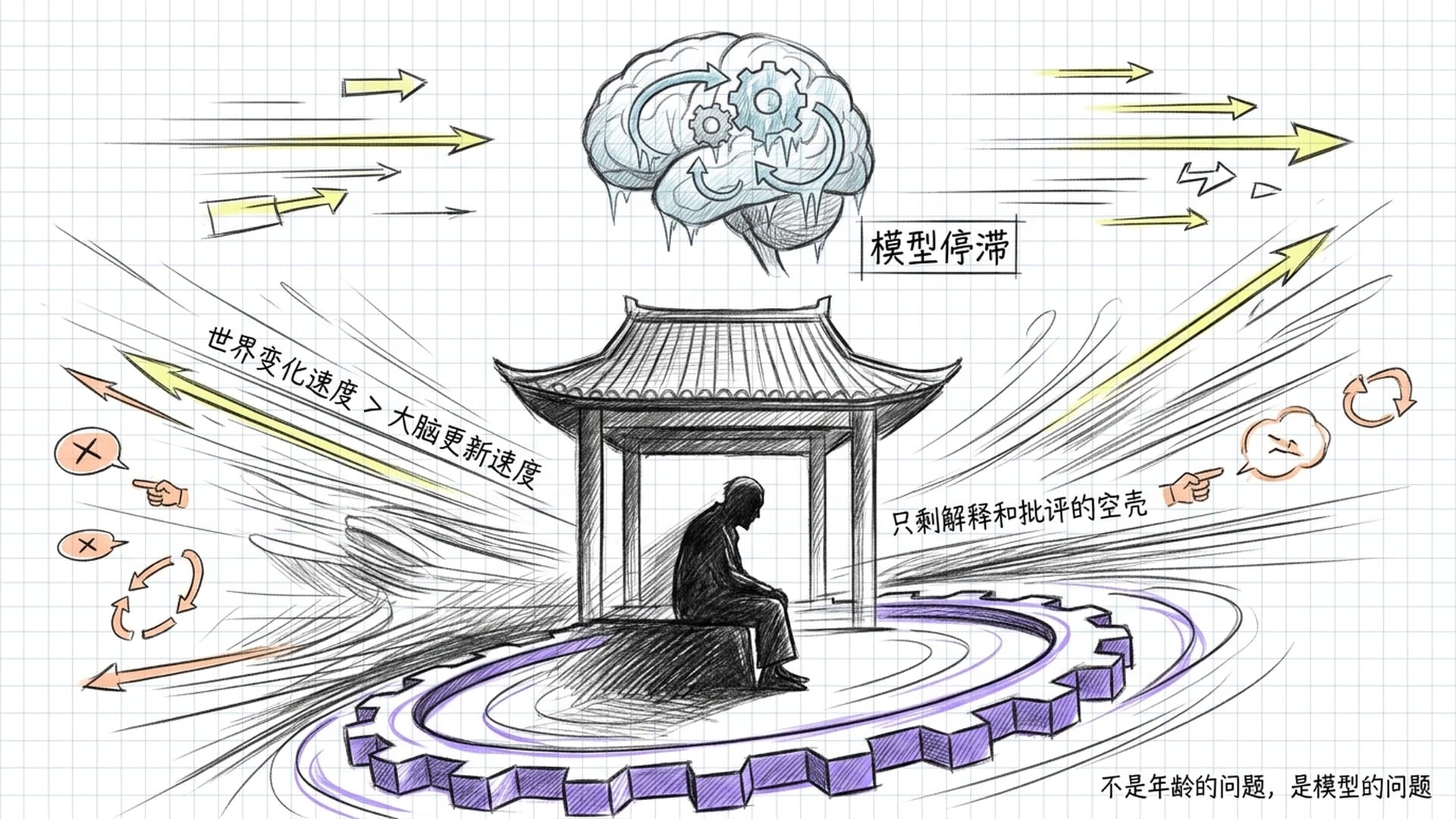

霍维的理论有一个隐藏前提:世界的规律是相对稳定的。只有世界稳定,大脑才能通过不断更新,让内部模型越来越接近真实。但如果世界变化的速度,快过你大脑更新模型的速度,整套误差最小化的逻辑就崩了。你永远在用一个过时的模型,预测一个已经不再是那个世界的世界。

如果学习速度跟不上世界变化速度,人就会变成一个只剩解释和批评的空壳。预测已经失灵,行动已经失灵,只剩下一张嘴,不停地解释昨天的世界为什么和今天不一样。

这个现象不用去哪里找,走进任何一家茶馆、任何一个小区的凉亭,都能看到一排这样的人。他们曾经是厉害角色,大脑在三四十年前有一套对世界极其准确的解释。但世界早就变了,他们的模型没有跟着更新,于是只剩下一件事可做——解释。解释别人为什么错了,解释年轻人为什么不懂,解释社会为什么变味了。

这不是年龄的问题。这是模型的问题。

我见过六十多岁还在新行业里每天下注的人,也见过三十岁就开始只解释不行动的人。区别只在一点——他们的模型,还在不在被现实捶打着更新。

更新模型,是一场内部的小型葬礼

大脑更新模型,从来不是免费的。

在神经科学里,这种本能叫**预测误差厌恶——大脑会把那些和自己模型不符的信号自动过滤掉、忽略掉,甚至歪曲一下再接收。在心理学里,它叫确认偏误**——你会不自觉地只去寻找支持已有模型的证据,对那些颠覆模型的证据视而不见。

所以人即使活在一个一直在变的世界里,也会本能地抓着一个静止的模型不放手,然后把另一只手盖在自己的眼睛上。

每一次被现实打脸,都意味着你要亲手承认自己原来那套解释错了。更新模型这四个字,说起来轻巧,做起来,每一次都像一场内部的小型葬礼——你得亲手埋掉一个曾经有用的旧自己。

人到中年以后为什么越来越难学东西?不是因为脑子变笨了,而是因为要埋的旧自己越来越多。

两千五百年前,佛陀说的是同一件事

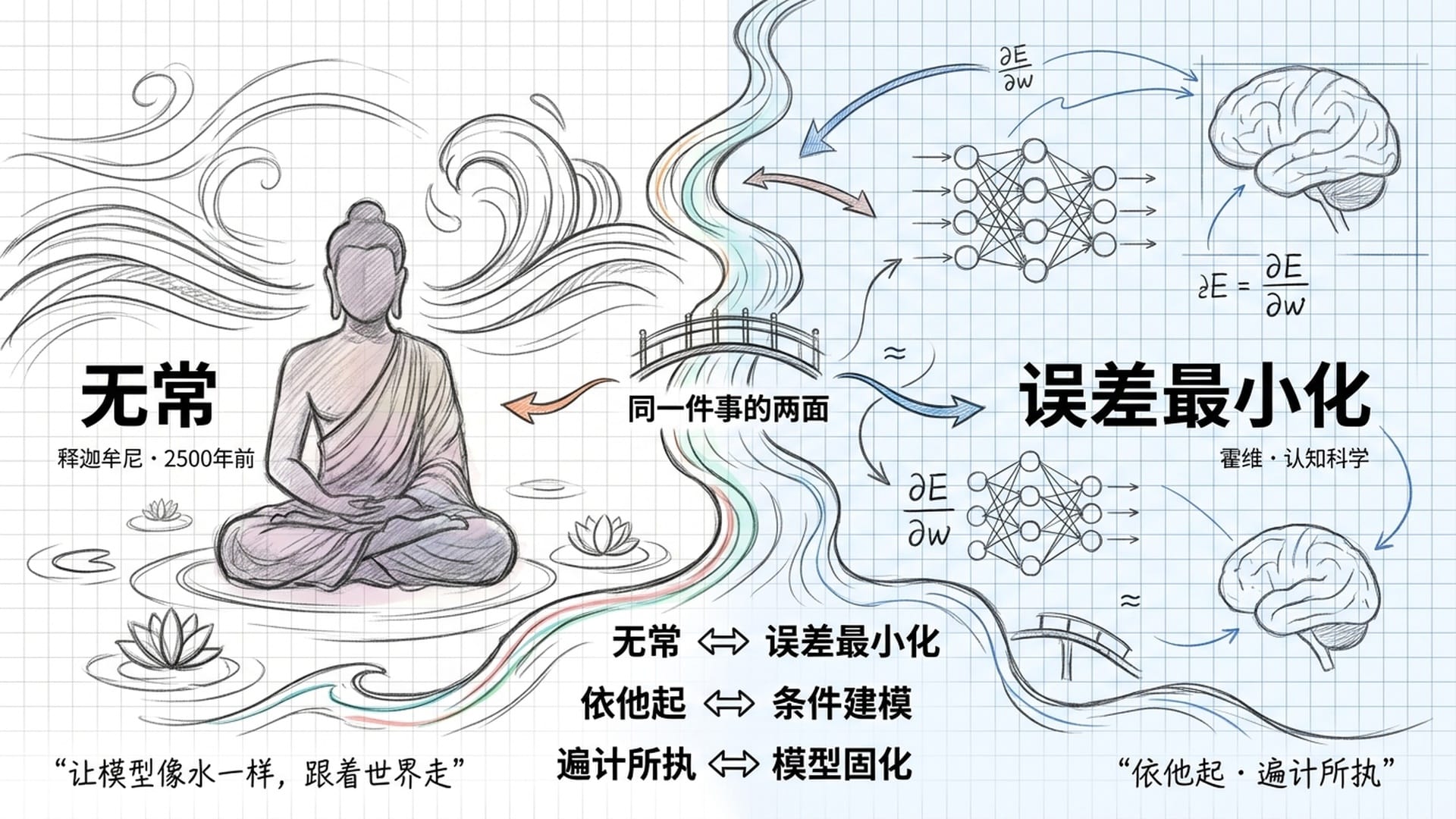

佛学里有一个词,叫无常。释迦牟尼反复强调:世界上没有任何东西是稳定不变的,一切都在流动。所以人不能把任何一套解释当成绝对。你今天的模型解释得通昨天,不代表它能解释明天。

霍维讲误差最小化,佛陀讲无常——两人讲的是同一件事的两面。

霍维说,大脑的工作是不断让内部模型逼近真实。佛陀说,你想把模型握紧到完全等于真实,做不到,因为真实本身一直在动。所以你要做的,不是把模型攥得越来越死,而是让模型像水一样,跟着世界走。

在唯识学里,这叫**依他起——你的认知、你的模型,从来不是独立存在的东西,它依赖于条件而升起。条件在变,模型就要跟着变。一旦你把某个模型当成永恒真理——在佛学里这叫遍计所执**——你就已经脱离了真实。

一个做量化的朋友说只解释不下注等于零,一个讲唯识学的古人说把模型执实就是烦恼——他们隔着两千五百年,讲的是同一件事。

对人工智能的直接启示

这个洞察,对今天正在做的人工智能有一个非常直接的映射。

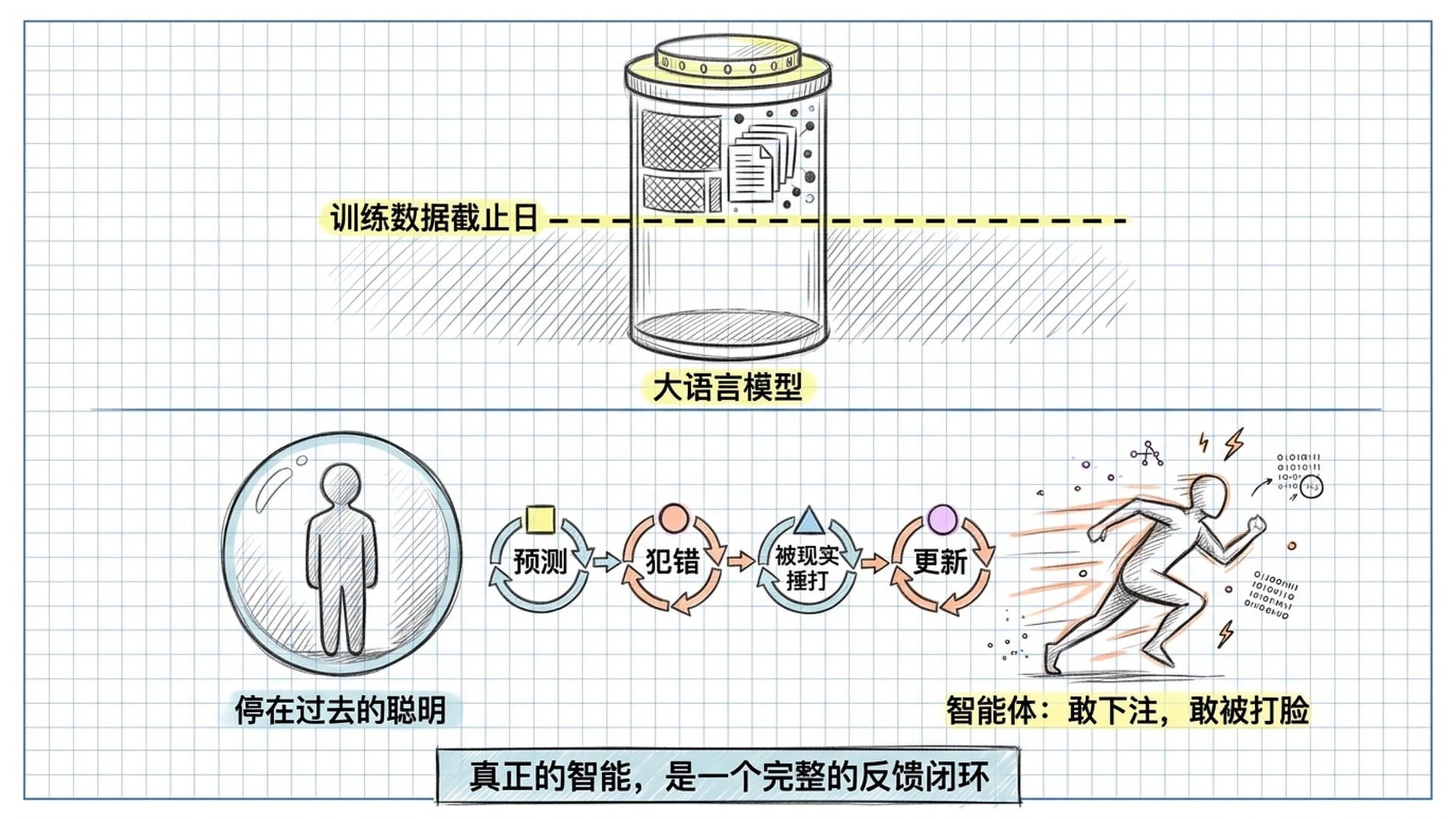

今天绝大多数的大语言模型,本质上都是预测机器——被训练去预测下一个词是什么。它们是霍维这套理论最完美的工程实现。但它们有一个巨大的短板:它们的世界,停在训练数据截止的那一天。它们不在真实世界里下单,不拿自己的解释去撞现实,所以模型无法根据反馈更新。它们解释得再漂亮,也只是一个时间胶囊里的聪明。

这也是为什么现在有这么多人在做智能体、做反馈闭环、做真实世界的实时学习——真正的智能,不是在静止的训练集上把损失函数压到最低,而是把自己扔进世界里,去预测、去犯错、去被现实捶打、去更新。

人工智能下一步的飞跃,不会来自更大的参数或更多的训练数据,而会来自一个更完整的预测反馈循环——一个敢下注、敢被打脸、敢改模型的系统。

最后,回到我们自己

所以,大脑是预测机器,还是解释机器?

我的看法是——它既不是纯粹的预测机器,也不是纯粹的解释机器。 它是一个在解释、预测、反馈、更新这个循环里不停跑动的系统。这个循环一旦停下来,大脑就从一台活的推理引擎,慢慢退化成一台僵死的解释装置。

这件事,对每个人都有一个非常具体的提醒:

你有没有已经很久,没有主动更新过你对某件事的模型?你是不是常常用十年前、二十年前对世界的解释,去预测今天的世界?你对年轻一代的判断、对行业的判断、对人工智能的判断、对经济的判断,甚至对你自己伴侣的判断——这些模型,最后一次和真实对撞,是什么时候?

如果一个模型太久没有被误差修正,它就死了。 表面上你还在用它,其实它已经不在做工作了,它只是在重复它自己。

霍维说大脑是预测机器,我同意。但我想在这句话后面补上一句——

能预测的前提,是愿意犯错、愿意被反馈、愿意在每一次被现实打脸之后,低下头去改模型。说起来像一套冷冰冰的算法,但做起来,它叫勇气。

|  |  |  |